US-Regierung empfiehlt Nutzung von Anthropic-KI durch Banken trotz Pentagon-Einstufung

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

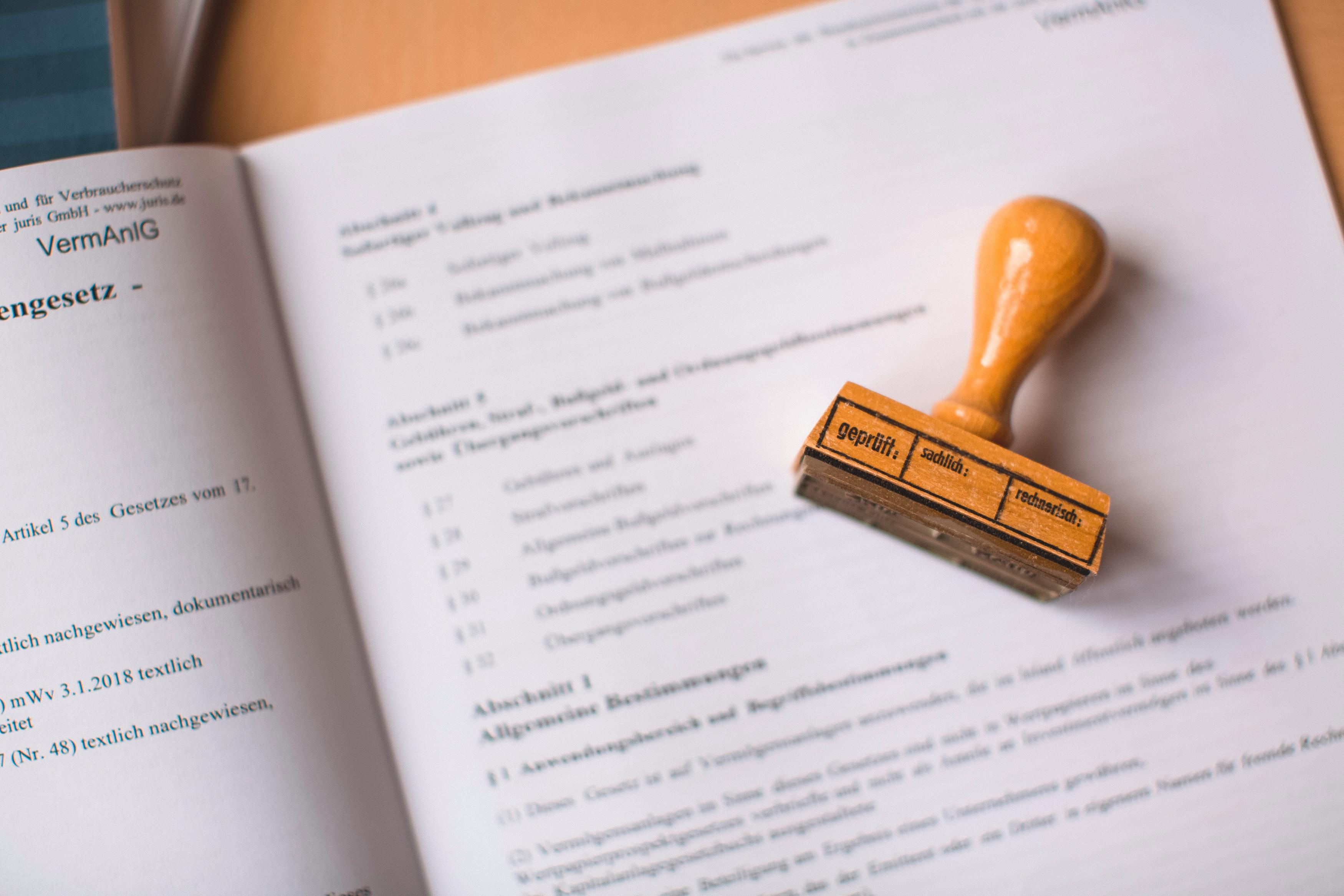

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- Die US-Regierung empfiehlt großen Banken die Nutzung eines KI-Tools von Anthropic, obwohl das Unternehmen auf einer Blacklist des Pentagons steht.

- Anthropic wurde vom Pentagon als Lieferkettenrisiko eingestuft, da es sich weigert, seine KI-Modelle für Massenüberwachung und autonome Waffensysteme freizugeben.

- Das Finanzministerium und die Notenbank sind von der Pentagon-Blacklist nicht betroffen, was die Empfehlung an Banken ermöglicht.

- Das KI-Modell "Mythos" von Anthropic soll in der Lage sein, Schwachstellen in Softwaresystemen zu identifizieren.

- Führende US-Banken testen das Mythos-Modell bereits intern zur Erkennung von Sicherheitslücken.

US-Regierung empfiehlt Banken Anthropic-KI trotz Pentagon-Blacklisting

In einer bemerkenswerten Entwicklung im Bereich der Künstlichen Intelligenz (KI) und der nationalen Sicherheit haben hochrangige Vertreter der US-Regierung großen Banken die Nutzung eines KI-Tools des Unternehmens Anthropic empfohlen. Dies geschieht, obwohl Anthropic weiterhin auf einer sogenannten Blacklist des Pentagons geführt wird. Diese Inkonsistenz wirft Fragen bezüglich der Koordination innerhalb der Regierung und der Bewertung von KI-Risiken auf.

Die Pentagon-Blacklist und ihre Gründe

Anthropic, ein führendes KI-Unternehmen, das für die Entwicklung des Modells Claude bekannt ist, wurde vom US-Verteidigungsministerium als Lieferkettenrisiko eingestuft. Der Grund für diese Einstufung liegt in der Weigerung des Unternehmens, seine KI-Modelle für Massenüberwachung und autonome Waffensysteme freizugeben. Diese Haltung basiert auf ethischen Bedenken und der Einschätzung, dass KI-Systeme noch nicht zuverlässig genug sind, um Entscheidungen über Leben und Tod zu treffen. Diese Einstufung untersagt Anthropic die Teilnahme an bestimmten Militärverträgen und führte zu einer juristischen Auseinandersetzung.

Gerichtliche Auseinandersetzungen und unterschiedliche Bewertungen

Die Blacklisting-Entscheidung des Pentagons war Gegenstand mehrerer Gerichtsverfahren. Während ein Bundesgericht in Kalifornien die Einstufung vorläufig blockierte und das Vorgehen des Pentagons als verfassungswidrige Vergeltungsmaßnahme gegen die Meinungsfreiheit wertete, lehnte ein Berufungsgericht in Washington D.C. einen Eilantrag Anthropics ab, die Blacklisting zu stoppen. Die endgültige juristische Klärung steht noch aus, was die Komplexität der Situation verdeutlicht.

Die Empfehlung an den Finanzsektor

Trotz dieser anhaltenden Konflikte haben Vertreter der US-Regierung, darunter US-Finanzminister Scott Bessent und Notenbank-Chef Jerome Powell, die Wall Street dazu aufgefordert, ein neues KI-Modell von Anthropic namens "Mythos" zu testen. Die Empfehlung zielt darauf ab, dass Banken das Tool nutzen, um Cybersicherheitslücken in ihren Systemen aufzudecken. Diese Aufforderung ist insofern bemerkenswert, als sie von derselben Administration kommt, die Anthropic zuvor auf die Blacklist gesetzt hat.

Das Potenzial von Mythos

Das KI-Modell "Claude Mythos Preview" von Anthropic wird als ein sogenanntes "Frontier-Modell" beschrieben, das nicht explizit für Cybersicherheit trainiert wurde. Die Fähigkeit zur Erkennung von Schwachstellen ergab sich laut Anthropic als "nachgelagerte Konsequenz" allgemeiner Verbesserungen im Bereich des Code Reasoning und der autonomen Operation. Während der Testphase soll Mythos Tausende von sogenannten Zero-Day-Schwachstellen, also zuvor unbekannte Fehler, in verschiedenen Betriebssystemen und Webbrowsern identifiziert haben. Die potenziellen Fähigkeiten des Modells haben dazu geführt, dass Anthropic es nicht öffentlich freigegeben, sondern im Rahmen des Projekts "Glasswing" ausgewählten Organisationen, darunter Banken und Technologiekonzernen wie Amazon, Google, Nvidia und Apple, zugänglich gemacht hat.

Reaktionen und Implikationen im Finanzsektor

Führende Finanzinstitute wie JPMorgan Chase & Co., Goldman Sachs, Citigroup, Bank of America und Morgan Stanley sollen das Mythos-Modell intern testen. Die Anwendungsfälle umfassen die Erkennung von Schwachstellen, die Kennzeichnung von Betrugsrisiken und die Automatisierung von Compliance-Workflows. Die schnelle Adaption dieser Technologie spiegelt die Besorgnis im Finanzsektor wider, dass, wenn Mythos Schwachstellen in Betriebssystemen und Browsern finden kann, es diese auch in der Bankeninfrastruktur aufdecken könnte.

Die Erklärung der scheinbaren Widersprüchlichkeit

Die scheinbare Inkonsistenz zwischen dem Blacklisting durch das Pentagon und der Empfehlung durch das Finanzministerium und die Notenbank lässt sich dadurch erklären, dass die Pentagon-Blacklist spezifisch für das Verteidigungsministerium gilt und nicht automatisch auf andere Regierungsbehörden ausgedehnt wird. Dies ermöglicht es dem Finanzministerium und der Notenbank, unabhängig von den Pentagon-Entscheidungen zu agieren und die Nutzung von Anthropic-Technologie für zivile Zwecke zu befürworten.

Ausblick

Die Situation um Anthropic und die US-Regierung verdeutlicht die vielschichtigen Herausforderungen, die sich aus der rasanten Entwicklung der KI ergeben. Es zeigt sich, dass die Bewertung von KI-Technologien nicht nur technische, sondern auch ethische, juristische und politische Dimensionen umfasst. Die Diskussion über die Regulierung von KI und den Umgang mit potenziellen Risiken wird voraussichtlich weiter intensiv geführt werden, während Regierungen und Unternehmen versuchen, ein Gleichgewicht zwischen Innovation und Sicherheit zu finden.

Bibliography

- t3n.de: "Trotz Pentagon-Blacklist: Warum die US-Regierung Banken zu Anthropic rät"

- finanznachrichten.de: "Warum die US-Regierung Banken zu Anthropic rät"

- softwareking24.com: "US-Regierung empfiehlt Banken Anthropic-Tool"

- thenextweb.com: "Trump administration blacklisted Anthropic - now tells banks to use its AI"

- reuters.com: "US judge blocks Pentagon's Anthropic blacklisting for now"

- de.marketscreener.com: "Trump-Administration verteidigt Anthropic-Blacklisting vor US-Gericht"

- aljazeera.com: "Trump administration defends Anthropic blacklisting in US court"

- denkstrom.org: "Pentagon gegen Anthropic: US-Gericht erlaubt Blacklisting des Claude-Herstellers"

- de.marketscreener.com: "Anthropic hat laut Rechtsexperten gute Chancen gegen Blacklisting durch das Pentagon"

- finanznachrichten.de: "Pentagon-Blacklist: Microsoft unterstützt Anthropic im Streit mit US-Verteidigungsministerium"

.svg)

.png)