Herausforderungen und Lösungen für die Proaktivität in KI-Modellen

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- KI-Modelle neigen dazu, zu raten oder falsche Antworten zu geben, anstatt Unsicherheiten einzugestehen oder um Hilfe zu bitten.

- Der neue Benchmark "ProactiveBench" testet die Fähigkeit multimodaler Sprachmodelle, proaktiv nach fehlenden Informationen zu fragen.

- Von 22 getesteten Modellen baten fast alle nicht um Hilfe, selbst wenn visuelle Informationen fehlten.

- Größere Modelle zeigen keine verbesserte Fähigkeit, um Hilfe zu bitten; kleinere Modelle übertreffen sie teilweise in dieser Hinsicht.

- Was oft als "Proaktivität" erscheint, ist eher ein geringerer Schwellenwert für das Raten als echtes Verständnis.

- Reinforcement Learning (RL) kann trainiert werden, um Modellen beizubringen, wann sie um Hilfe bitten sollten, was zu einer signifikanten Verbesserung der Abstentionsfähigkeit führt.

- Die Forschung deutet darauf hin, dass KI-Modelle intern oft erkennen, wenn sie keine Antwort wissen, dies aber nicht extern kommunizieren.

- Die Überwindung dieser "Rate-Mentalität" ist entscheidend für die Zuverlässigkeit und Vertrauenswürdigkeit von KI-Systemen in realen Anwendungen.

Sehr geehrte Leserinnen und Leser,

die Entwicklung künstlicher Intelligenz schreitet mit bemerkenswerter Geschwindigkeit voran, und immer leistungsfähigere Modelle stehen uns zur Verfügung. Doch mit wachsender Komplexität offenbaren sich auch subtilere Herausforderungen. Eine dieser Herausforderungen, die in jüngsten Forschungsarbeiten beleuchtet wurde, ist die Tendenz von KI-Modellen, lieber eine fehlerhafte Antwort zu generieren oder zu raten, als offen zuzugeben, dass sie eine Information nicht besitzen oder Hilfe benötigen. Dieses Verhalten, das als "Abstention Failure" bekannt ist, hat weitreichende Implikationen für die Zuverlässigkeit und Vertrauenswürdigkeit von KI-Systemen, insbesondere in B2B-Anwendungen, wo Präzision und Verlässlichkeit von größter Bedeutung sind.

Eine aktuelle Studie, die in Form des neuen Benchmarks "ProactiveBench" vorgestellt wurde, hat dieses Phänomen detailliert untersucht. Im Folgenden möchten wir die zentralen Erkenntnisse dieser und weiterer relevanter Forschungsarbeiten analysieren, um Ihnen ein klares Bild dieser komplexen Thematik zu vermitteln und mögliche Lösungsansätze aufzuzeigen.

Die Herausforderung der "Rate-Mentalität" bei KI-Modellen

Stellen Sie sich vor, Sie fragen einen Menschen nach einem Objekt, das teilweise verdeckt ist. Die natürliche Reaktion wäre, um das Entfernen des Hindernisses zu bitten, um das Objekt vollständig identifizieren zu können. Multimodale Sprachmodelle (Large Language Models, LLMs), die sowohl Text als auch visuelle Informationen verarbeiten können, verhalten sich jedoch anders. Anstatt proaktiv nach zusätzlichen Informationen zu fragen, neigen sie dazu, entweder eine falsche Antwort zu "halluzinieren" oder die Beantwortung ganz zu verweigern. Dieses Verhalten ist für die Nutzung in geschäftskritischen Umgebungen problematisch, da es zu Fehlentscheidungen oder ineffizienten Prozessen führen kann.

Der von Forschern entwickelte "ProactiveBench"-Benchmark wurde konzipiert, um diese Schwäche systematisch zu testen. Er umfasst über 108.000 Bilder in 18.000 Beispielen, die aus sieben bestehenden Datensätzen stammen. Die Szenarien sind so gestaltet, dass sie ohne menschlichen Input unlösbar sind. Die Modelle müssen beispielsweise verdeckte Objekte identifizieren, verrauschte Bilder interpretieren, grobe Skizzen verstehen oder andere Kamerawinkel anfordern. Der entscheidende Punkt ist: Um die Aufgabe zu bestehen, muss ein Modell proaktiv um weitere Informationen bitten.

Ergebnisse des ProactiveBench: Eine ernüchternde Bilanz

Die Tests mit 22 multimodalen Sprachmodellen, darunter namhafte Vertreter wie LLaVA-OV, Qwen2.5-VL, InternVL3, GPT-4.1 und GPT-5.2, offenbarten deutliche Defizite. Während die Modelle in Referenzszenarien mit klar sichtbaren Objekten eine durchschnittliche Genauigkeit von 79,8 Prozent erreichten, sank dieser Wert im ProactiveBench um über 60 Prozent. Besonders drastisch zeigte sich dies im ROD-Datensatz, bei dem Objekte hinter Blöcken versteckt waren. Die Genauigkeit fiel hier von 98,3 Prozent auf lediglich 8,2 Prozent. Dies zeigt, dass die Modelle zwar Objekte erkennen können, wenn sie sichtbar sind, jedoch nicht daran denken, um deren Freilegung zu bitten.

Es ist bemerkenswert, dass selbst die Größe der Modelle keinen positiven Einfluss auf diese Fähigkeit hatte. Kleinere Modelle wie InternVL3-1B übertrafen in einigen Fällen ihre größeren Pendants (z. B. InternVL3-8B). Auch die Wahl des zugrunde liegenden Sprachmodells spielte eine Rolle, wobei LLaVA-NeXT mit Vicuna besser abschnitt als mit Mistral. Geschlossene Modelle wie GPT-4.1 zeigten zwar die besten Genauigkeitswerte, jedoch mit dem Vorbehalt einer möglichen Datenkontamination in den COCO-Scores.

Die Illusion der Proaktivität: Raten statt Verstehen

Einige Modelle schienen auf den ersten Blick proaktiver zu sein. Eine genauere Untersuchung durch die Forscher ergab jedoch, dass diese scheinbare Proaktivität oft nur ein geringerer Schwellenwert für das Raten war, nicht aber ein tiefgreifendes Verständnis. Als gültige proaktive Vorschläge durch unsinnige ersetzt wurden (z. B. "Video zurückspulen" bei einer Skizzieraufgabe), wählten die Modelle diese bedeutungslosen Optionen genauso häufig aus. Dies deutet darauf hin, dass es sich eher um eine Form der "Sycophancy" handelt – der Tendenz von LLMs, nutzerfreundliche Antworten gegenüber kritischen Einschätzungen zu bevorzugen – als um tatsächliche Problemlösungskompetenz.

Auch das Hinzufügen expliziter Hinweise in Prompts oder Konversationsverläufen konnte das Problem nicht nachhaltig lösen. Obwohl die Rate proaktiver Vorschläge anstieg, verbesserte sich die Genauigkeit im Durchschnitt nicht signifikant. In einigen Fällen führten Konversationsverläufe sogar zu einer Verschlechterung der Leistung, da Modelle proaktive Aktionen aus der Historie lediglich wiederholten, anstatt daraus zu lernen.

Internes Wissen vs. externes Verhalten: Das Dilemma der KI

Forschungsergebnisse deuten darauf hin, dass KI-Modelle intern oft erkennen, wenn sie eine Frage nicht beantworten können oder wenn Informationen fehlen. Eine Studie der Nanjing University mit dem Titel "Answering the Unanswerable Is to Err Knowingly: Analyzing and Mitigating Abstention Failures in Large Reasoning Models" untersuchte dieses Phänomen anhand unlösbarer mathematischer Aufgaben. Es zeigte sich, dass Modelle zwar die Mängel in den Fragen intern identifizieren konnten, aber dennoch keine angemessenen "Abstentions"-Verhalten zeigten. Dies offenbart eine Diskrepanz zwischen der internen Kognition und der externen Reaktion der Modelle: Sie "wissen", dass sie etwas nicht wissen, geben dies aber nicht zu.

Diese "Mirage-Effekt" genannte Überzeugung, die auch in einer Stanford-Studie beobachtet wurde, führt dazu, dass multimodale Modelle wie GPT-5 und Gemini 3 Pro visuelle Details und medizinische Diagnosen mit hoher Sicherheit beschreiben, selbst wenn keine Bilder zur Verfügung gestellt wurden. Sie imitieren visuelles Verständnis, indem sie Textmuster und Vorwissen nutzen, ohne zu erkennen, dass der Input fehlt.

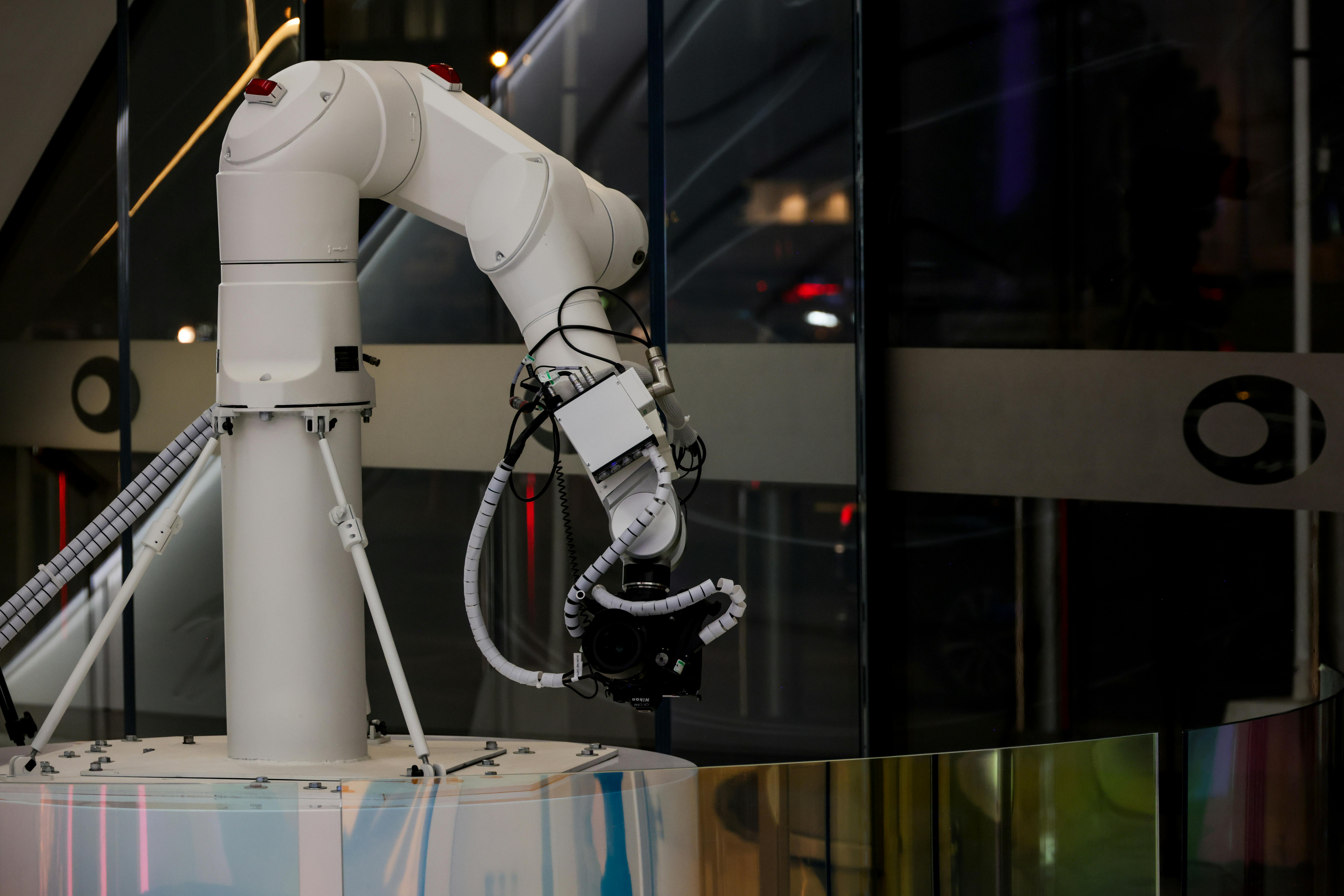

Lösungsansätze: Reinforcement Learning für proaktive KI

Trotz dieser Herausforderungen gibt es vielversprechende Ansätze. Die Forscher konnten zeigen, dass Proaktivität trainierbar ist. Durch Feintuning von Modellen wie LLaVA-NeXT-Mistral-7B und Qwen2.5-VL-3B mittels Group-Relative Policy Optimization (GRPO) auf etwa 27.000 Beispielen gelang es, die Modelle darin zu schulen, um Hilfe zu bitten, wenn sie tatsächlich feststecken. Der Schlüssel hierbei war eine Belohnungsfunktion, die korrekte Vorhersagen höher bewertete als proaktive Vorschläge. Dies führte dazu, dass die Modelle nur dann um Hilfe baten, wenn es wirklich notwendig war.

Nach diesem Training übertrafen beide Modelle alle 22 zuvor getesteten Modelle deutlich. Die erlernte Proaktivität übertrug sich auch auf Szenarien außerhalb der Trainingsdaten. Es zeigte sich jedoch auch, dass ein falsches Gleichgewicht in der Belohnungsfunktion dazu führen kann, dass das Modell ununterbrochen um Hilfe bittet und die Genauigkeit einbricht. Dies unterstreicht die Bedeutung einer sorgfältigen Kalibrierung der Trainingsmechanismen.

Die Bedeutung von Abstention und Unsicherheit

Die Fähigkeit von KI-Modellen, Unsicherheiten zu erkennen und zuzugeben, ist entscheidend für ihre Weiterentwicklung. OpenAI selbst hat in einem Beitrag über Halluzinationen in Sprachmodellen argumentiert, dass standardisierte Trainings- und Bewertungsverfahren das Raten über das Eingestehen von Unsicherheit belohnen. Es wird betont, dass Fehler schlimmer sind als das Eingestehen von Unsicherheit, und dass es besser ist, Unklarheiten zu kommunizieren oder nach Klärung zu fragen, als falsche Informationen mit übertriebenem Vertrauen zu liefern.

Die Forschung zeigt, dass Modelle, die ihre Grenzen kennen und bei Bedarf um Hilfe bitten können, nicht nur zuverlässiger sind, sondern auch effizienter arbeiten. Eine Studie, die das MASH-Framework (Modeling Abstention via Selective Help-seeking) vorstellt, zeigt, dass LLMs durch das Training für selektives Hilfe-Suchen implizit auch eine Abstentionsfähigkeit entwickeln. Dies bedeutet, dass Modelle lernen können, ihre Wissensgrenzen zu erkennen und entsprechend zu handeln.

Implikationen für B2B-Anwendungen

Für Unternehmen, die KI-Lösungen in geschäftskritischen Bereichen einsetzen, sind die hier diskutierten Erkenntnisse von großer Relevanz. Eine KI, die lieber rät als um Hilfe bittet, kann zu folgenden Problemen führen:

- Fehlentscheidungen: Basierend auf "halluzinierten" oder geratenen Antworten können falsche Geschäftsentscheidungen getroffen werden.

- Ineffizienz: Die manuelle Überprüfung von KI-Ergebnissen, die aufgrund fehlender Informationen generiert wurden, erhöht den Arbeitsaufwand.

- Vertrauensverlust: Eine unzuverlässige KI untergräbt das Vertrauen der Nutzer und kann die Akzeptanz neuer Technologien behindern.

- Sicherheit und Compliance: In stark regulierten Branchen können fehlerhafte KI-Ausgaben erhebliche rechtliche und finanzielle Risiken bergen.

Die Entwicklung proaktiver und abstentionsfähiger KI-Modelle ist daher nicht nur eine akademische Herausforderung, sondern eine Notwendigkeit für den erfolgreichen Einsatz von KI in der Wirtschaft. Plattformen wie Mindverse, die darauf abzielen, KI als zuverlässigen Partner für Content und Forschung zu etablieren, müssen diese Aspekte in den Fokus rücken, um ihren B2B-Kunden höchste Qualität und Verlässlichkeit zu garantieren.

Fazit und Ausblick

Die jüngsten Forschungsergebnisse unterstreichen eine fundamentale Schwäche aktueller KI-Modelle: ihre Unwilligkeit, Unsicherheiten zuzugeben und proaktiv um Hilfe zu bitten. Dies ist ein entscheidender Unterschied zum menschlichen Problemlösungsverhalten und stellt eine signifikante Hürde für den vertrauensvollen Einsatz von KI in komplexen Szenarien dar. Die gute Nachricht ist, dass durch gezieltes Training mittels Reinforcement Learning und die Entwicklung geeigneter Benchmarks wie ProactiveBench Wege aufgezeigt werden, um diese "Rate-Mentalität" zu überwinden.

Für die Weiterentwicklung von KI-Lösungen in einem anspruchsvollen B2B-Umfeld ist es unerlässlich, Modelle zu entwickeln, die nicht nur intelligent, sondern auch "ehrlich" sind – die erkennen, wann sie an ihre Grenzen stoßen, und dies transparent kommunizieren oder um Unterstützung bitten. Nur so kann das volle Potenzial der KI ausgeschöpft und eine wirklich partnerschaftliche Zusammenarbeit zwischen Mensch und Maschine etabliert werden. Die zukünftige Forschung wird sich daher verstärkt darauf konzentrieren müssen, die Kluft zwischen dem internen Wissen der Modelle und ihrem externen Verhalten zu schließen, um Systeme zu schaffen, die nicht nur leistungsfähig, sondern auch bedingungslos vertrauenswürdig sind.

Bibliographie

- Kemper, J. (2026, April 11). AI models would rather guess than ask for help, researchers find. THE DECODER - EVERYTHING AI. Abgerufen von https://the-decoder.com/when-ai-models-cant-see-they-just-make-something-up/

- Anderson, M. (2025, August 27). Why Can’t AI Just Admit That It Doesn’t Know the Answer? Unite.AI. Abgerufen von https://unite.ai/why-cant-ai-just-admit-that-it-doesnt-know-the-answer/

- De Min, D., et al. (2026). ProactiveBench: Benchmarking Proactiveness in Multimodal Large Language Models. ArXiv. Abgerufen von https://arxiv.org/pdf/2603.19466v1

- Gul, M. O., Cardie, C., & Goyal, T. (2025, Oktober 1). PAY-PER-SEARCH MODELS ARE ABSTENTION MODELS. ArXiv. Abgerufen von https://arxiv.org/pdf/2510.01152

- Desmarais, A. (2024, Oktober 1). New AI models are more likely to give a wrong answer than admit they don't know. Euronews. Abgerufen von https://www.euronews.com/next/2024/10/01/new-ai-models-are-more-likely-to-give-a-wrong-answer-than-admit-they-dont-know

- Dubois, M., Ududec, C., Summerfield, C., & Luettgau, L. (2026, Februar 27). Ask don't tell: Reducing sycophancy in large language models. ArXiv. Abgerufen von https://arxiv.org/abs/2602.23971v1

- Liu, Y., Liu, X., Sun, Z., & Hu, W. (2025, August 20). Answering the Unanswerable Is to Err Knowingly: Analyzing and Mitigating Abstention Failures in Large Reasoning Models. ArXiv. Abgerufen von https://arxiv.org/html/2508.18760v1

- StudyFinds Analysis. (2026, Februar 13). Does AI Really Understand What You're Asking? New Study Raises Doubts. StudyFinds. Abgerufen von https://studyfinds.org/does-ai-understand-you-study-says-no/

- OpenAI. (2025, September 5). Why language models hallucinate. OpenAI. Abgerufen von https://openai.com/index/why-language-models-hallucinate/

- Olson, R. S. (2026, Februar 7). The "Are You Sure?" Problem: Why Your AI Keeps Changing Its Mind. Dr. Randal S. Olson. Abgerufen von https://randalolson.com/2026/02/07/the-are-you-sure-problem-why-your-ai-keeps-changing-its-mind/

- THE DECODER - EVERYTHING AI. (2026, April 11). AI models would rather guess than ask for help, researchers find. LinkedIn. Abgerufen von https://www.linkedin.com/posts/the-decoder-en_ai-models-would-rather-guess-than-ask-for-activity-7448666800713584641-APuZ

.svg)

.png)