Attention.ai: Wachstum und Innovation in der KI-gestützten Vertriebsautomatisierung

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

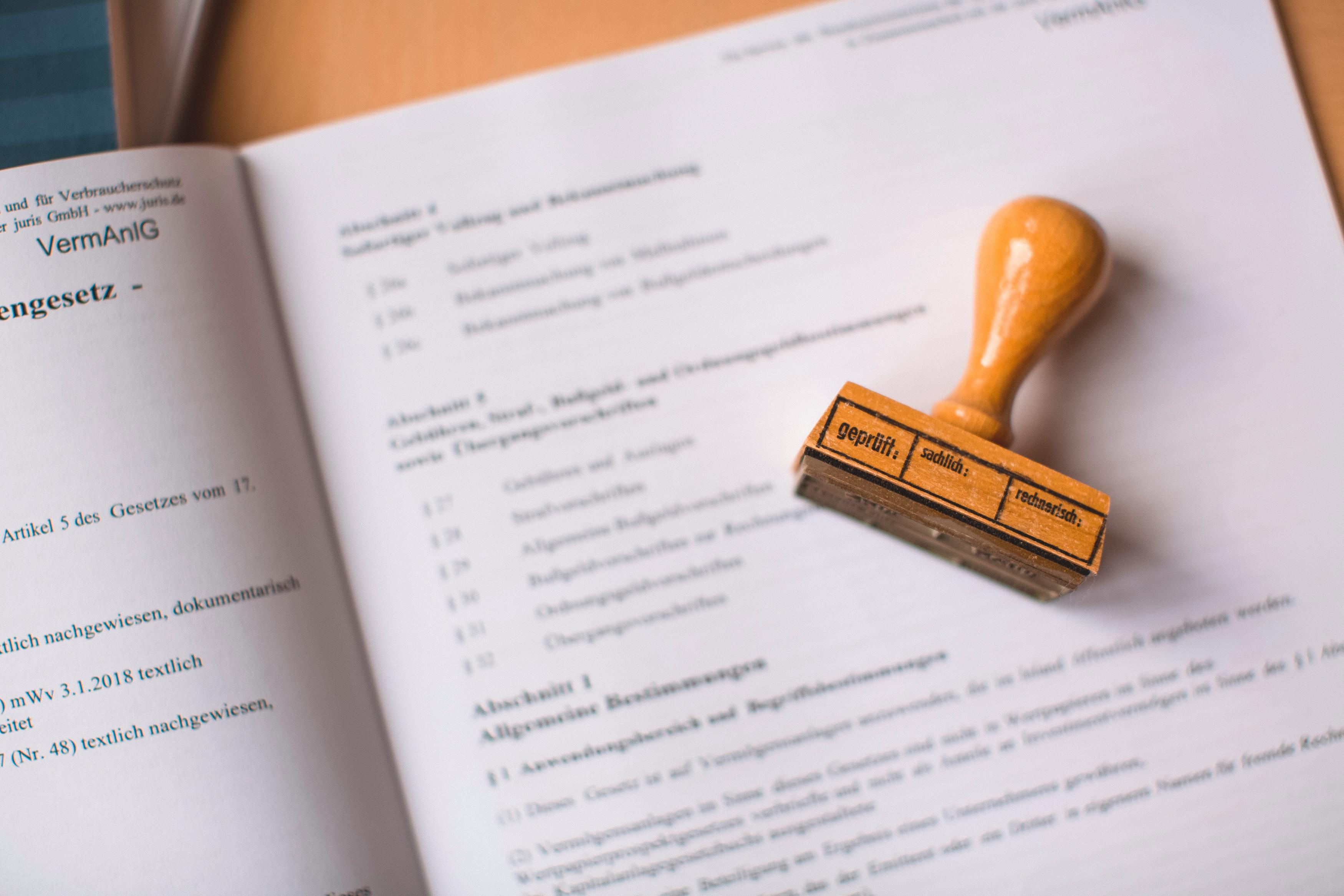

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Der schnelle Überblick

- Attention.ai etabliert sich als führendes Unternehmen im Bereich der KI-gestützten Vertriebsautomatisierung.

- Das Unternehmen verzeichnete ein signifikantes Wachstum und erreicht einen hohen Annual Recurring Revenue (ARR).

- Strategische Partnerschaften und schnelle Produktinnovationen sind zentrale Erfolgsfaktoren.

- Attention.ai legt den Fokus auf die Entwicklung agentischer KI-Lösungen, die autonome Aktionen ermöglichen.

- Die Skalierung erfolgt durch eine flexible Produktstrategie und eine schlanke Organisationsstruktur.

Attention.ai: Ein aufstrebender Akteur in der KI-Landschaft

In der dynamischen Welt der Künstlichen Intelligenz (KI) positioniert sich das Unternehmen Attention.ai zunehmend als ein wichtiger Akteur. Beobachter der Branche erkennen eine Entwicklung, die es neben etablierten Größen wie Anthropic, Profound und Snowflake einordnet. Diese Einschätzung basiert auf der Fähigkeit des Unternehmens, schnell zu skalieren und innovative Lösungen im Bereich der Vertriebsautomatisierung bereitzustellen.

Die Entwicklung von Attention.ai

Attention.ai wurde im Jahr 2021 von Anis Bennaceur und Mathias Wickenburg gegründet. Die ursprüngliche Mission bestand darin, Vertriebsteams durch die Umwandlung von Kundeninteraktionen in strukturierte Daten und umsetzbare Erkenntnisse zu unterstützen. Ein früher Fokus lag auf der automatischen Befüllung von CRM-Systemen mittels Large Language Models (LLMs), die Transkripte von Verkaufsgesprächen verarbeiteten.

Das Unternehmen erreichte innerhalb von zehn Monaten einen Annual Recurring Revenue (ARR) von 1 Million US-Dollar. Die anfängliche Preisgestaltung von 80 US-Dollar pro Nutzer und Monat wurde sukzessive auf bis zu 200 US-Dollar erhöht, ohne auf nennenswerten Widerstand zu stoßen. Dies deutet auf eine hohe Zahlungsbereitschaft der Kunden und eine starke Wertwahrnehmung hin. Die Netto-Umsatzbindung (Net Retention Rate) erreichte 210 Prozent, was auf eine hohe Kundenzufriedenheit und die Fähigkeit zur Umsatzexpansion bei bestehenden Kunden hindeutet.

Attention.ai beschäftigt ein Team von etwa 60 Mitarbeitern, darunter 30 bis 35 Ingenieure. Das Produktteam ist schlank strukturiert, wobei Produktentscheidungen lange Zeit in den Händen der Gründer verblieben, um schnelle Iterationen und eine marktorientierte Entwicklung zu gewährleisten.

Strategische Ausrichtung und Produktinnovation

Die Wettbewerbsposition von Attention.ai basiert auf einer Multi-Produkt-Strategie. Als Konkurrenten auf den Markt kamen, entschied sich das Unternehmen nicht für Preissenkungen, sondern für Innovation. Neue Produktlinien wurden schnell eingeführt, wobei das eigene Vertriebsteam als interne Nutzergruppe diente, um Feedback zu generieren und die Produktentwicklung voranzutreiben. Dies ermöglichte die schnelle Anpassung an Marktanforderungen und die Differenzierung von Wettbewerbern.

Zwei wesentliche Produktentwicklungen entstanden aus dem direkten Nutzerverhalten:

- Generalisierte Erkenntnisse (Generalized Insights): Kunden äußerten den Wunsch, Erkenntnisse über eine Vielzahl von Anrufen hinweg zu gewinnen, anstatt sich auf einzelne Gespräche zu beschränken. Dies führte zur Entwicklung von Funktionen, die es ermöglichten, Fragen über Hunderte von Konversationen hinweg zu beantworten.

- Automatisierte Anruf-Bewertung (Automated Call Scoring): Basierend auf der Beobachtung, dass Kunden Anrufe manuell bewerteten, entwickelte Attention.ai ein System zur automatischen Bewertung von Verkaufsgesprächen. Dieses System identifiziert Coaching-Möglichkeiten und unterstützt die Leistungsverbesserung der Vertriebsmitarbeiter.

Diese Innovationen trugen dazu bei, die Wettbewerbsfähigkeit zu erhalten und die Preisgestaltung aufrechtzuerhalten. Die Produktentwicklung orientierte sich dabei stets an den Bedürfnissen der anspruchsvollsten Kunden und der Frage, ob die Gründer die Funktionen selbst täglich nutzen würden.

Der Übergang zu agentischer KI

Ein zentraler Wandel in der SaaS-Landschaft ist der Übergang von Co-Piloten zu agentischen KI-Systemen. Während Co-Piloten menschliche Überprüfung erfordern, agieren agentische Systeme autonom. Attention.ai vollzog diesen Übergang schrittweise. Zunächst wurden Nutzer dazu angehalten, von der KI generierte CRM-Einträge oder E-Mails zu validieren. Mit zunehmendem Vertrauen der Nutzer wurde die manuelle Verifizierung reduziert, was zu einer graduellen Erhöhung der Autonomie führte.

Die Herausforderung bei agentischen Systemen liegt in der Navigation durch komplexe CRM-Daten und der Bewältigung unvorhersehbarer Vertriebsabläufe. Um dies zu gewährleisten, setzt Attention.ai sogenannte "Forward Deployment Engineers" ein. Diese Ingenieure verbringen bis zu zwei Wochen bei Kunden vor Ort, um die Integration des Produkts in die bestehende Infrastruktur und Teamstruktur sicherzustellen. Dieses Vorgehen ist primär für Kunden mit hohen jährlichen Auftragswerten (ACV) von über 20.000 US-Dollar relevant.

Die Vision besteht darin, CRM-Systeme als aktive Tools zunehmend zu ersetzen. Stattdessen soll ein System entstehen, das Vertriebsteams zuhört, analysiert und in ihrem Namen agiert, beispielsweise durch die Vorbereitung von täglichen Anruf-Briefings oder die Generierung von Business Cases.

Finanzierung und Marktpositionierung

Attention.ai konnte frühzeitig signifikante Finanzierungen sichern. Die Preisgestaltung von KI-Produkten stellt eine Herausforderung dar, da sich LLM-Kosten schnell ändern und das Nutzerverhalten schwer vorhersehbar ist. Das Unternehmen verfolgt eine Strategie, die auf einer Bruttomarge von 80 Prozent basiert. Bei der Einführung neuer agentischer Funktionen wird die Preisgestaltung nicht erzwungen, sondern in Gesprächen mit Kunden ermittelt, was zu einer wertorientierten Preisgestaltung führt.

Der durchschnittliche ACV stieg innerhalb von zwei Jahren auf 120.000 US-Dollar, eine 15-fache Steigerung. Dies wird durch den offensichtlichen Mehrwert in Form von Zeitersparnis, strategischen Erkenntnissen und einer verbesserten Konversionsrate ermöglicht. Die agentischen Workflows richten sich primär an große Organisationen, da kleine und mittelständische Unternehmen (KMU) diese Komplexität in der Regel nicht benötigen.

Herausforderungen und Erkenntnisse

Im Verlauf der Expansion stieß Attention.ai auch auf Herausforderungen. Ein Fehler war die Entwicklung von Funktionen, die von den Nutzern nicht wirklich benötigt wurden, wie ein frühes Echtzeit-Coaching-Modul. Solche Funktionen wurden schnell eingestellt, um technische Schulden zu vermeiden und die Innovationsgeschwindigkeit aufrechtzuerhalten.

Die schlanke Produktorganisation, mit einer Produkt-Designerin, die auch Code schreibt, und Ingenieuren, die in Produktbegriffen denken, ermöglicht eine hohe Marktnähe und schnelle Lieferzyklen. Die Zusammenarbeit mit den intelligentesten Kunden ist dabei ein entscheidender Faktor für die Produktentwicklung.

Zusammenfassend lässt sich festhalten, dass der Erfolg von Attention.ai auf einer Kombination aus schneller Produktinnovation, einer agilen Organisationsstruktur, der Fokussierung auf agentische KI-Lösungen und einer wertorientierten Preisgestaltung beruht. Das Unternehmen demonstriert, wie in einem sich schnell entwickelnden Markt durch Anpassungsfähigkeit und Kundennähe eine führende Position eingenommen werden kann.

Vergleich mit anderen Akteuren

Die Erwähnung von Attention.ai neben Unternehmen wie Anthropic und Snowflake ist ein Indikator für seine wachsende Bedeutung. Anthropic, bekannt für seine Claude-Modelle, hat in den letzten Jahren ein exponentielles Wachstum erlebt. Berichten zufolge erreichte Anthropic im April 2026 eine annualisierte Umsatzrate von 30 Milliarden US-Dollar, was einem 80-fachen Wachstum entspricht. Das Unternehmen hat zudem eine strategische Partnerschaft mit Snowflake geschlossen, die eine 200-Millionen-Dollar-Integration der Claude-Modelle in die Snowflake AI Data Cloud vorsieht. Diese Kooperation zielt darauf ab, die Nutzung von KI in Unternehmen zu vereinfachen und die Datensicherheit zu gewährleisten, indem die Modelle direkt in der Datenumgebung der Kunden ausgeführt werden.

Ein weiteres Beispiel für die schnelle Entwicklung im KI-Bereich ist das Startup Subquadratic, das im Mai 2026 eine neue Transformer-Architektur vorgestellt haben soll. Diese Architektur, basierend auf Subquadratic Sparse Attention (SSA), soll eine lineare Skalierung der Rechenleistung mit der Kontextlänge ermöglichen, was eine erhebliche Verbesserung gegenüber der quadratischen Skalierung herkömmlicher Transformer darstellen würde. Sollten sich diese Behauptungen bestätigen, könnte dies die Kosten für Langkontext-Operationen drastisch senken und neue Anwendungsfelder für KI eröffnen.

Diese Entwicklungen unterstreichen die schnelle und dynamische Natur des KI-Marktes, in dem Unternehmen wie Attention.ai durch innovative Ansätze und strategische Fokussierung ihren Platz finden und ausbauen können.

Bibliographie

- Frin, Timothe. "Inside Attention’s path to a multi-product AI suite redefining sales automation". Substack, 19. März 2026.

- getlatka.com. "How Attentions AI hit $3.3M revenue with a 30 person team in 2025."

- Nasdaq. "Snowflake Announced a $200 Million Deal With Anthropic, but It Wasn't Enough for Investors. Here's Why." 4. Dezember 2025.

- The Associated Press. "AI startup Anthropic commits $100 billion to Amazon's AWS over next 10 years". Chron.com, 21. April 2026.

- i10x.ai. "Anthropic-Snowflake $200M Deal: Secure Claude AI Integration". 8. Dezember 2025.

- time.news. "Anthropic says it hit a $30 billion revenue run rate after 'crazy' 80x growth". 10. Mai 2026.

- Yadav, Rohit. "A Startup Just Broke the Transformer Scaling Law". Analytics Drift, 6. Mai 2026.

- Lakdawala, Ali. "The Architecture Is the Moat". 24. April 2026.

- Digital Applied. "MCP Adoption Statistics 2026: Model Context Protocol". 19. April 2026.

- opentools.ai. "Anthropic and Snowflake Forge $200M Alliance to Boost Enterprise AI with Claude Integration". 5. Dezember 2025.

.svg)

.png)