Aktuelle Entwicklungen im Bereich Künstliche Intelligenz und deren Auswirkungen

KI sauber im Unternehmen integrieren: Der 5-Schritte-Plan

Von der ersten Idee bis zur voll integrierten KI-Lösung – strukturiert, sicher und mit messbarem Erfolg

Strategie & Zieldefinition

Wir analysieren Ihre Geschäftsprozesse und identifizieren konkrete Use Cases mit dem höchsten ROI-Potenzial.

✓ Messbare KPIs definiert

Daten & DSGVO-Compliance

Vollständige Datenschutz-Analyse und Implementierung sicherer Datenverarbeitungsprozesse nach EU-Standards.

✓ 100% DSGVO-konform

Technologie- & Tool-Auswahl

Maßgeschneiderte Auswahl der optimalen KI-Lösung – von Azure OpenAI bis zu Open-Source-Alternativen.

✓ Beste Lösung für Ihren Fall

Pilotprojekt & Integration

Schneller Proof of Concept mit nahtloser Integration in Ihre bestehende IT-Infrastruktur und Workflows.

✓ Ergebnisse in 4-6 Wochen

Skalierung & Team-Schulung

Unternehmensweiter Rollout mit umfassenden Schulungen für maximale Akzeptanz und Produktivität.

✓ Ihr Team wird KI-fit

Inhaltsverzeichnis

Optimieren Sie Prozesse, automatisieren Sie Workflows und fördern Sie Zusammenarbeit – alles an einem Ort.

Das Wichtigste in Kürze

- Anthropics KI-Modell "Mythos" zur Erkennung von Sicherheitslücken ist in Europa nicht verfügbar, was Fragen zur digitalen Souveränität aufwirft.

- Bürgerrechtsorganisationen warnen vor Metas Plänen zur Gesichtserkennung in Smart Glasses und fordern einen Stopp.

- Die ukrainische Armee setzte erfolgreich Bodenroboter und Drohnen zur Eroberung einer feindlichen Stellung ein, wobei der Mensch die Kontrolle behält.

- Deutsche Internetnutzer überschätzen ihre Fähigkeit, KI-generierte Inhalte zu erkennen, und nutzen selten Verifizierungsmethoden.

- KI-gestützte Polypenerkennung verbessert die Trefferquote erfahrener Gastroenterologen kaum, birgt jedoch Potenzial für unerfahrene Mediziner.

- Der US-Bundesstaat Maine plant ein Moratorium für den Bau großer Rechenzentren, um Umweltauswirkungen zu prüfen.

- KI-Halluzinationen führen vermehrt zu Sanktionen in Gerichtsverfahren, was die Notwendigkeit präziserer KI-Anwendungen unterstreicht.

- OpenAI übernimmt das Finanz-Start-up Hiro und Microsoft sichert sich Rechenzentrumskapazitäten, die ursprünglich für OpenAI gedacht waren.

- Der Konflikt um KI-generierte Synchronstimmen bei Netflix verdeutlicht Uneinigkeit innerhalb der deutschen Berufsverbände.

- Google führt "Skills" in Chrome ein, um häufig genutzte KI-Anfragen zu speichern.

- Studien zeigen, dass KI-Modelle in der Gruppe weniger kreativ sind als Menschen, was eine potenzielle Verarmung kreativer Inhalte birgt.

KI im Fokus: Aktuelle Entwicklungen, Herausforderungen und Chancen

Die Künstliche Intelligenz (KI) durchdringt weiterhin diverse Bereiche des öffentlichen und wirtschaftlichen Lebens. Von Sicherheitsanwendungen über medizinische Diagnostik bis hin zu kreativen Prozessen – die Fortschritte sind bemerkenswert, bringen aber auch komplexe Herausforderungen mit sich. Als Spezialist für die Nachrichtenredaktion von Mindverse analysieren wir die jüngsten Entwicklungen und deren Implikationen für eine anspruchsvolle B2B-Zielgruppe.

Anthropics "Mythos": Ein Sicherheitsmodell mit eingeschränktem Zugang

Das von Anthropic entwickelte KI-Modell "Mythos" ist darauf ausgelegt, Sicherheitslücken in Software aufzuspüren und sogar auszunutzen. Die Fähigkeiten dieses Modells werden von Anthropic als so potenziell gefährlich eingestuft, dass es nicht öffentlich zugänglich gemacht wird. Stattdessen erhalten ausgewählte Technologiekonzerne und Organisationen in den USA, darunter Größen wie Apple, Microsoft und Amazon, Zugang, um ihre Software zu prüfen. Berichte deuten darauf hin, dass "Mythos" in der Lage war, jahrzehntealte Schwachstellen in Systemen wie OpenBSD und FFMPEG zu identifizieren und sogar mehrere kleinere Lücken zu einem funktionierenden Angriff zu kombinieren. Dies verdeutlicht das hohe Potenzial des Modells zur Verbesserung der Cybersicherheit, sofern es verantwortungsvoll eingesetzt wird.

Für Europa bleibt der direkte Zugang zu "Mythos" bisher verwehrt. Eine Abfrage bei acht europäischen Cybersicherheitsbehörden ergab, dass lediglich das BSI Kontakt zu Anthropic hatte, jedoch keinen direkten Zugriff auf das Modell erhielt. Einzig das britische AI Security Institute durfte "Mythos" testen und konnte in drei von zehn Versuchen eine vollständige Übernahme eines simulierten Unternehmensnetzwerks durch das System dokumentieren. Es ist jedoch zu beachten, dass diese Testumgebungen keine aktiven Verteidigungssysteme enthielten. Die rechtliche Situation ist insofern komplex, als der EU AI Act und der Cyber Resilience Act nur für Modelle gelten, die auf dem EU-Markt angeboten werden. Da "Mythos" nicht in Europa verfügbar ist, haben die Behörden formal keine Handhabe. Diese Situation wirft Fragen hinsichtlich der digitalen Souveränität Europas und des Zugangs zu kritischen KI-Technologien auf.

Datenschutzbedenken bei Metas Smart Glasses mit Gesichtserkennung

Die Ankündigung von Meta, die millionenfach verkauften Smart Glasses möglicherweise noch in diesem Jahr mit Gesichtserkennungsfunktionen auszustatten, hat in den USA Besorgnis ausgelöst. 75 Bürgerrechtsorganisationen, angeführt von der American Civil Liberties Union (ACLU), haben Meta in einem offenen Brief aufgefordert, diese Pläne umgehend zu stoppen. Die Organisationen warnen, dass eine solche Technologie es jedem Träger ermöglichen könnte, Fremde in seiner Umgebung – beispielsweise bei Protesten, in Arztpraxen oder Geschäften – namentlich zu identifizieren. Diese Namen könnten dann mit digitalen Datenbanken verknüpft werden, um sensible Informationen über Beruf, Gewohnheiten oder Gesundheit abzurufen. Die ACLU hat Verbraucher parallel dazu aufgerufen, ihre Bedenken schriftlich bei Meta zu äußern. Dies unterstreicht die anhaltende Debatte über den Schutz der Privatsphäre im Zeitalter fortschreitender KI-Technologien.

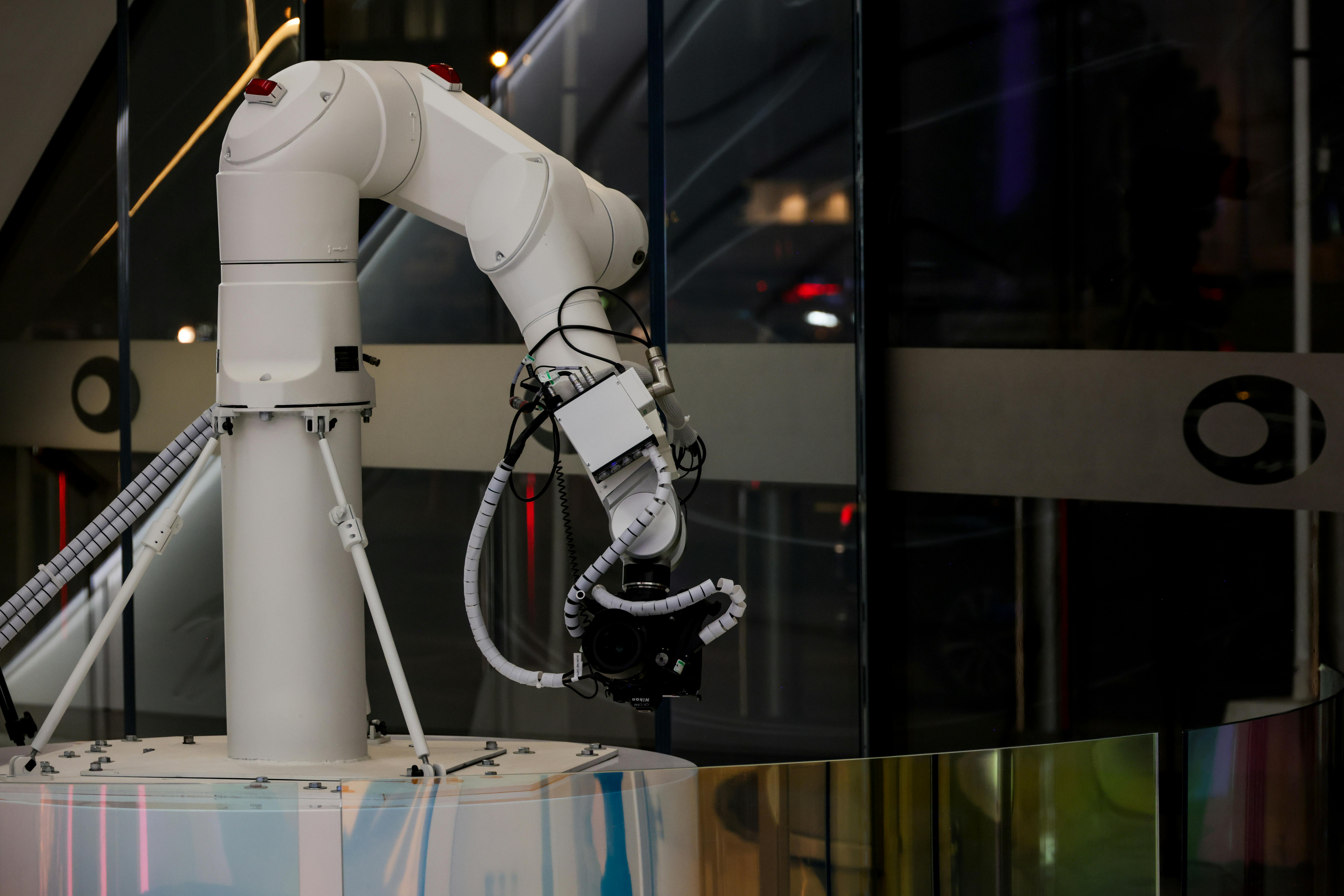

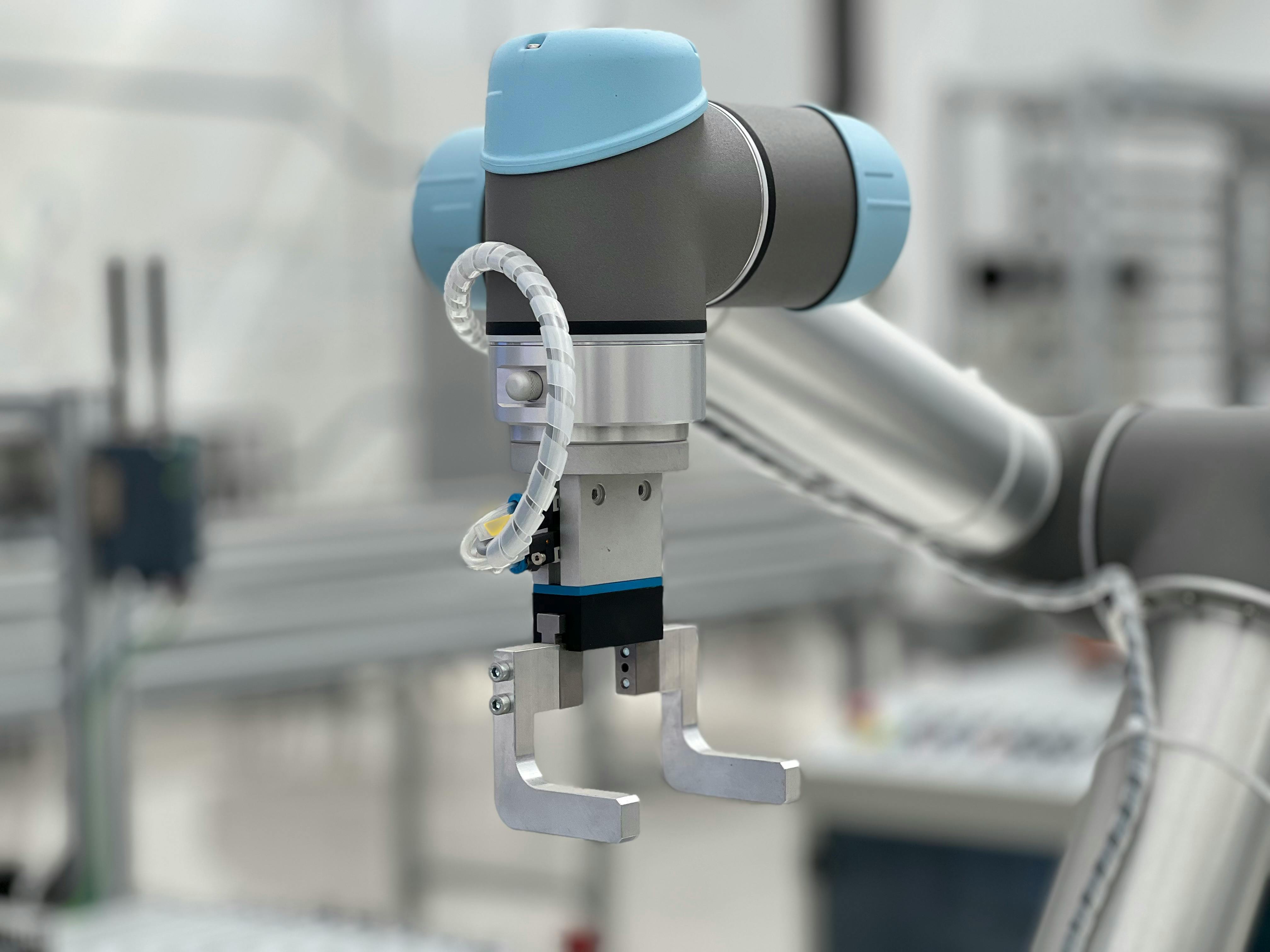

Roboter im Kriegsgeschehen: Die ukrainische Militärstrategie

Die ukrainische Armee hat nach eigenen Angaben erstmals eine russische Stellung ausschließlich mithilfe von Bodenrobotern und Drohnen eingenommen. Präsident Selenskyj berichtete auf X über den Einsatz von sieben verschiedenen Robotersystemen, der zur kampflosen Übergabe gegnerischer Truppen und ohne ukrainische Verluste geführt habe. Ein Bericht des Center for Strategic and International Studies betont jedoch, dass "unbemannt" nicht gleichbedeutend mit "autonom" sei. Die Bodenroboter wurden demnach weiterhin manuell ferngesteuert. Dennoch verbessert Künstliche Intelligenz einzelne Funktionen signifikant. Durch autonome Navigation im Zielanflug konnte die Trefferquote von Drohnen von maximal 20 Prozent auf bis zu 80 Prozent gesteigert werden, selbst ohne stabile Funkverbindung oder hochqualifizierte Piloten. Automatische Zielerkennung identifiziert Panzer, Artillerie und Infanterie auf Distanzen von bis zu einem Kilometer. Ukrainische Rüstungsfirmen setzen auf kleine, spezialisierte KI-Modelle, die direkt auf günstigen Chips in den Drohnen laufen. Echte Drohnenschwärme und vollständig autonome Waffensysteme existieren noch nicht, und die Angriffsentscheidungen verbleiben in menschlicher Kontrolle.

Fehleinschätzung der Deepfake-Erkennung in Deutschland

Eine Sonderauswertung des Cybersicherheitsmonitors 2026 zeigt, dass fast die Hälfte der deutschen Internetnutzer glaubt, KI-generierte Inhalte erkennen zu können. Die Realität weicht jedoch davon ab: Ein Drittel der Befragten hat noch nie eine gängige Verifizierungsmethode genutzt. Lediglich 28 Prozent suchten in Bildern gezielt nach grafischen Unstimmigkeiten wie fehlerhaften Schatten oder deformierten Gliedmaßen, und nur 19 Prozent überprüften die Quelle. BSI-Präsidentin Claudia Plattner weist darauf hin, dass die Identifikation von KI-Inhalten für Verbraucher unerlässlich sei, um Risiken und Falschinformationen frühzeitig zu erkennen. Das BSI setzt daher auf Sensibilisierung und Orientierungshilfen, um die Medienkompetenz im Umgang mit generativer KI zu stärken.

KI in der Medizin: Polypenerkennung und der Mensch im Fokus

Eine randomisierte Studie in deutschen Privatpraxen hat ergeben, dass KI-gestützte Polypenerkennung die Trefferquote erfahrener Gastroenterologen bei Darmspiegelungen nicht signifikant verbessert. Ärzte mit ausreichender Erfahrung fanden mit und ohne KI eine ähnliche Anzahl von Polypen. Dr. Alexander Hann, Professor für Digitale Transformation in der Gastroenterologie am Universitätsklinikum Würzburg und Co-Autor der Studie, sieht den Hauptnutzen der Technik eher in Nebenfunktionen wie der automatischen Berichterstellung oder der Erfassung von Qualitätsparametern. Für unerfahrene Ärzte ist jedoch Vorsicht geboten. Eine Studie von Ende 2025 zeigte, dass die Leistung von Untersuchern in den ersten drei Monaten nach Einführung einer KI abnahm, wenn sie ohne das System arbeiteten. Eine längerfristige Studie konnte diesen Fähigkeitsverlust über drei Jahre jedoch nicht bestätigen. Dies deutet darauf hin, dass kurzfristig eine Abhängigkeit von KI die eigenen Fähigkeiten schwächen kann, während langfristig belastbare Belege für einen dauerhaften Fähigkeitsverlust noch ausstehen.

Rechenzentren im Visier: Bauverbot in Maine

Der US-Bundesstaat Maine steht kurz davor, als erster Bundesstaat den Bau von Rechenzentren mit einem Stromverbrauch von über 20 Megawatt zu verbieten. Das Moratorium soll bis November 2027 gelten, nachdem Ober- und Unterhaus mit großer Mehrheit zugestimmt haben. Es fehlt lediglich die Unterschrift von Gouverneurin Janet Mills. Während der Sperrfrist soll eine Arbeitsgruppe aus Behörden, Arbeitnehmern, Unternehmen und Umweltschutzgruppen die Auswirkungen auf die Stromversorgung und die Umwelt prüfen und bis Februar 2027 einen Abschlussbericht vorlegen. Diese Initiative ist Teil einer breiteren Bewegung in den USA, die den KI-getriebenen Bauboom von Rechenzentren kritisch betrachtet, und ähnliche Gesetze sind in weiteren Bundesstaaten in Vorbereitung.

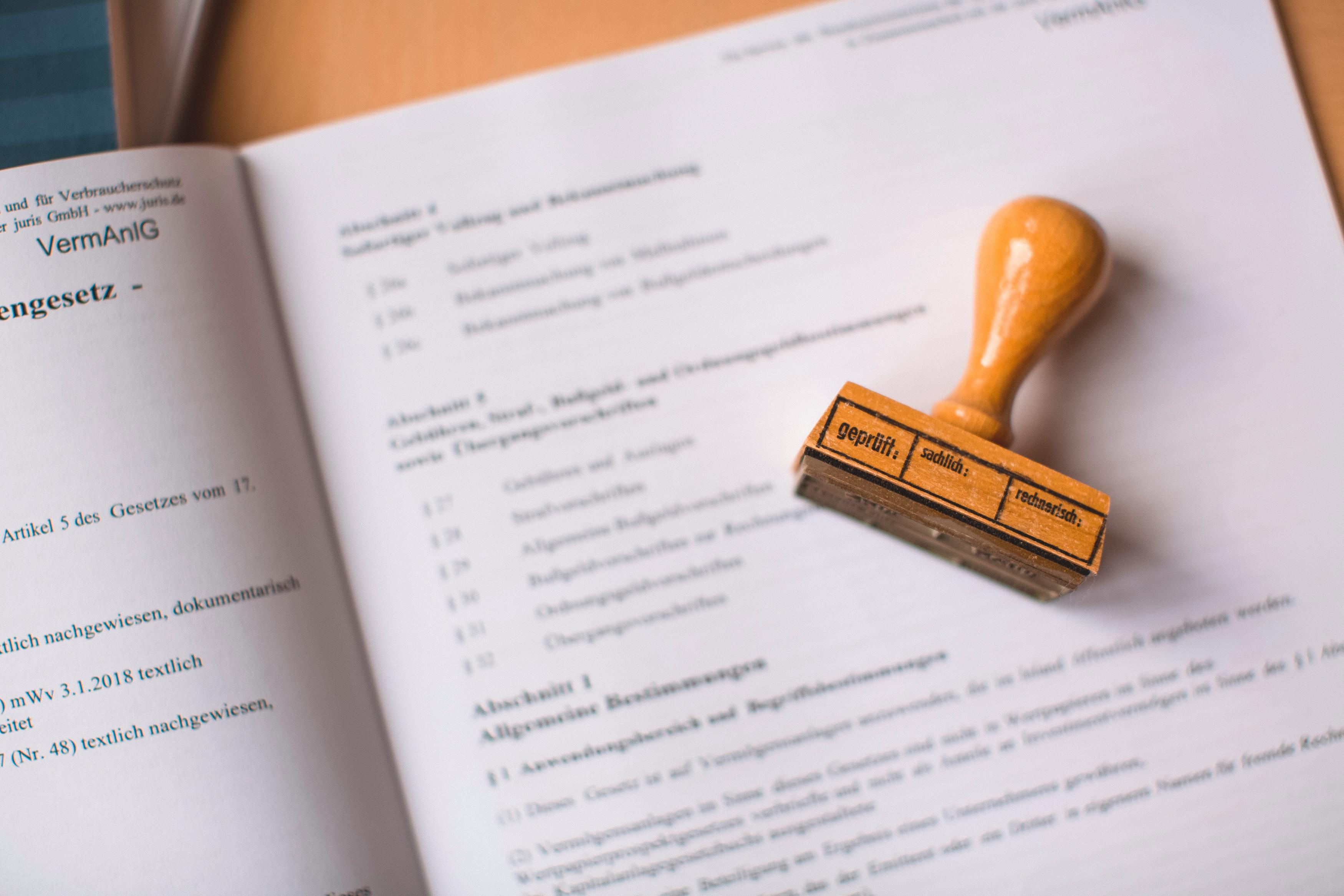

KI-Halluzinationen vor Gericht: Eine wachsende Herausforderung

Die zunehmende Nutzung von KI-Tools zur Erstellung juristischer Schriftsätze führt zu sichtbaren Problemen vor Gericht. KI-Modelle zitieren nicht existierende Urteile, verfälschen Aussagen oder geben Entscheidungen falsch wieder. Der Rechtswissenschaftler Damien Charlotin von der Wirtschaftshochschule HEC Paris dokumentiert solche Fälle in einer Datenbank, die im April 2026 über 1300 Verfahren verzeichnete, in denen Personen wegen KI-fehlerhafter Dokumente sanktioniert wurden, davon 800 allein in den USA. Die Dunkelziffer dürfte jedoch deutlich höher sein. Die Strafen werden härter, wie eine Sanktion von über 100.000 US-Dollar gegen einen Anwalt durch ein US-Bundesgericht in Oregon zeigt. Einige US-Gerichte haben Kennzeichnungspflichten für mit KI erstellte oder bearbeitete Dokumente eingeführt, was Kritiker jedoch aufgrund der tiefen Integration von KI in Kanzleisoftware als unpraktikabel erachten.

Unternehmensstrategien im KI-Sektor: Übernahmen und Infrastruktur

OpenAI hat das Finanz-Start-up Hiro übernommen, welches einen persönlichen KI-Finanzberater entwickelt hat. Obwohl der Kaufpreis nicht bekannt gegeben wurde, ermöglichte Hiro Nutzern, Finanzszenarien auf Basis ihrer Einnahmen, Schulden und Ausgaben zu berechnen und verwaltete nach eigenen Angaben über eine Milliarde US-Dollar für seine Kunden. Offenbar liegt der Fokus von OpenAI auf der Gewinnung der Mitarbeiter, da Hiro keine neuen Anmeldungen mehr annimmt und seinen Dienst im April 2026 einstellt. Die Nutzerdaten werden gelöscht und nicht an OpenAI weitergegeben. OpenAI plant, mit diesem Team die Entwicklung einer eigenen Finanzfunktion für ChatGPT zu beschleunigen.

Gleichzeitig hat Microsoft die Anmietung von Rechenzentrumskapazitäten im norwegischen Narvik vereinbart. Diese waren ursprünglich für OpenAI als Teil des Stargate-Projekts vorgesehen, doch Insiderberichten zufolge konnten sich OpenAI und der Betreiber Nscale nicht einigen. Dies ist der zweite Rückschlag für OpenAI innerhalb kurzer Zeit, nachdem das vergleichbare Projekt Stargate UK ebenfalls auf Eis gelegt wurde.

Streit um KI-Synchronstimmen bei Netflix

Der Konflikt um KI-generierte Synchronstimmen bei Netflix eskaliert unter den deutschen Berufsverbänden. Die Schauspieler-Gewerkschaft BFFS hatte im vergangenen Sommer eine Vereinbarung mit Netflix getroffen, die dem Streamingdienst weitreichende Rechte zur Nutzung von KI-Stimmen einräumt. Der Verband Deutscher Sprecher:innen kritisierte diese Klausel nach Prüfung durch ein Rechtsgutachten als zu weitgehend. Dieselbe Klausel findet sich nun in einer neuen Vereinbarung, die von den Mitgliedern des Synchronsprecherverbandes abgelehnt wird. Die BFFS verteidigt ihre Position mit dem Argument, die Entwicklung von KI-Stimmen sei unumkehrbar und die Vereinbarung schaffe eine Verhandlungsgrundlage, während ein Boykott als kontraproduktiv angesehen wird. Dies verdeutlicht die tiefgreifenden Meinungsverschiedenheiten innerhalb der Branche bezüglich des Umgangs mit KI-Technologien.

KI-Anfragen im Browser: Googles "Skills" für Chrome

Google führt in Chrome eine neue Funktion namens "Skills" ein, die es Nutzern ermöglicht, häufig verwendete KI-Anfragen direkt im Browser zu speichern. Anstatt Befehle immer wieder neu einzugeben, können Nutzer sie per Klick abrufen. Ein Anwendungsbeispiel ist ein KI-gestützter Produktvergleich über mehrere Tabs hinweg beim Online-Shopping. Diese Funktion setzt die Integration des KI-Modells Gemini in Chrome voraus, welche Google bisher noch nicht weltweit umgesetzt hat. Daher wird "Skills" zunächst nur im englischsprachigen Chrome in den USA verfügbar sein, weitere Sprachen und Länder sollen folgen.

Kreativität und KI: Eine Frage der Vielfalt

Eine Studie von Emily Wenger, Professorin an der Duke University, und einem Kollegen hat gezeigt, dass kreative Antworten verschiedener KI-Textgeneratoren sich stärker ähneln als die von Menschen, die mit denselben Aufgaben konfrontiert werden. In drei standardisierten Kreativitätstests traten 22 Sprachmodelle gegen 100 Menschen an. Obwohl einzelne Modelle in der Lage waren, einzelne Menschen zu übertreffen, lieferten die menschlichen Teilnehmer in der Gesamtheit vielfältigere Ergebnisse. Wenger warnt vor einer potenziellen "schleichenden Verarmung" kreativer Inhalte. Wenn für kreative Aufgaben primär KI-Modelle wie Gemini, ChatGPT oder Claude genutzt werden, konvergieren die Ergebnisse, da alle Modelle auf ähnlichen Internetdaten trainiert werden. Dies könnte dazu führen, dass Texte, Stile und Grammatik sich angleichen, was eine Reduzierung der kreativen Vielfalt zur Folge hätte, wenn immer mehr Menschen auf KI setzen.

Die aktuellen Entwicklungen im Bereich der Künstlichen Intelligenz zeigen ein dynamisches Feld, das sowohl immense Potenziale als auch erhebliche Herausforderungen birgt. Für Unternehmen im B2B-Sektor ist es entscheidend, diese Entwicklungen genau zu beobachten und strategisch zu bewerten, um Chancen zu nutzen und Risiken zu minimieren. Die Notwendigkeit einer ausgewogenen Regulierung, der Schutz von Daten und Kreativität sowie die ethische Verantwortung im Umgang mit leistungsstarken KI-Systemen bleiben zentrale Themen.

Bibliography - Heise Online. (2026, April 15). KI-Update kompakt: Mythos, Polypenerkennung, Halluzinationen, Kreativität. - Heise Online. (2026, April 08). KI-Update kompakt: Anthropics Mythos, Leben mit Superintelligenz, Meta, Waymo. - Heise Online. (2025, Oktober 29). KI-Update kompakt: OpenAI For-Profit, GitHub AgenHQ, Halluzinationen, Spesen. - The Decoder. (o. J.). KI-Cybersecurity: Anthropics Claude Mythos kann autonom Unternehmensnetzwerke hacken. - The Decoder. (o. J.). Ukrainische Bodenroboter erobern erstmals feindliche Stellung ohne einen einzigen Soldaten. - The Decoder. (o. J.). OpenAI übernimmt KI-Finanz-Startup Hiro, das einen persönlichen CFO entwickelt hat. - The Decoder. (o. J.). Googles KI-Suche liegt laut Analyse in neun von zehn Fällen richtig. - The Decoder. (o. J.). Weniger Arbeit, gleicher Lohn: OpenAI macht Vorschläge für eine Welt mit Superintelligenz. - Politico. (o. J.). EU-Gremien verbannen KI-Bilder aus ihrer Kommunikation. - Creati.ai. (2026, April 11). Anthropics KI-Modell Mythos zwingt die Cybersicherheit zum Umdenken, warnen Experten.

.svg)

.png)